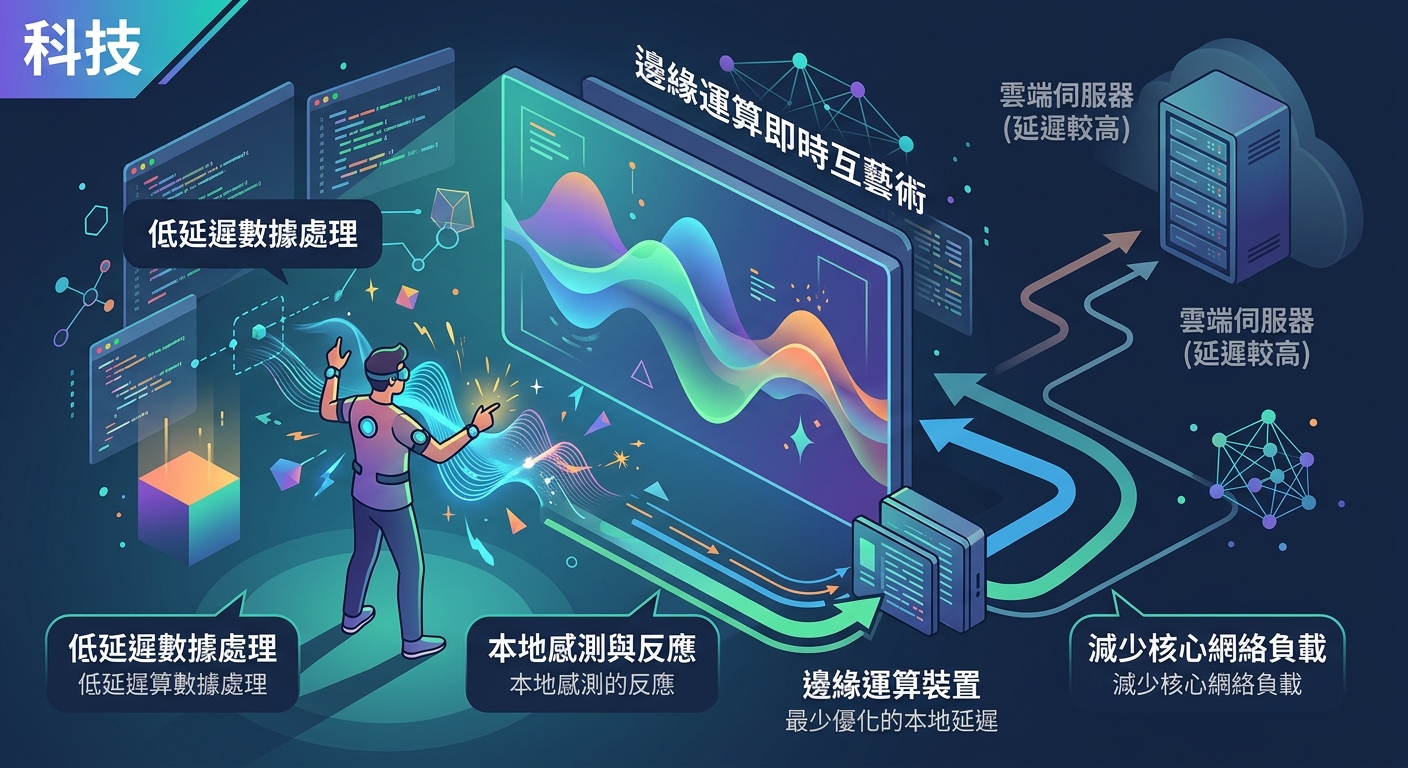

當觀眾走進展場,燈光隨著他們的動作即時變化,聲音跟著情緒波動起伏。這不是科幻電影場景,而是邊緣運算互動藝術正在實現的創作可能。傳統互動裝置常因網路延遲或雲端處理速度限制,無法達到真正的即時回應。邊緣運算技術將AI運算能力直接部署在裝置端,讓藝術作品能在毫秒級時間內對觀眾做出反應,創造前所未有的沉浸式體驗。

邊緣運算互動藝術透過本地端AI運算實現毫秒級即時反應,結合感測器、邊緣裝置與創作軟體形成完整系統。創作者需掌握硬體選型、模型優化、感測器整合三大技術環節,並注意延遲控制、電源管理等實務挑戰。從簡單動作辨識到複雜情感分析,邊緣運算正在重新定義互動藝術的創作邊界與觀眾體驗深度。

為什麼互動藝術需要邊緣運算

傳統雲端運算架構在藝術創作中面臨三個核心問題。

第一是延遲。當觀眾做出動作,訊號需要傳送到遠端伺服器處理,再回傳結果。這個過程通常需要100到500毫秒,對於需要即時反應的互動藝術來說太慢了。人類感知延遲的閾值約在20毫秒左右,超過這個時間就會感覺到明顯的遲滯感。

第二是頻寬限制。高解析度影像或多路感測器資料持續上傳會消耗大量網路頻寬。在展場環境中,網路品質不穩定是常態,資料傳輸中斷會直接影響作品呈現。

第三是隱私考量。許多互動藝術涉及臉部辨識或身體動作追蹤,觀眾的生物特徵資料如果上傳雲端會引發隱私疑慮。邊緣運算將資料處理保留在本地端,只輸出抽象化的互動指令,避免敏感資料外流。

邊緣運算把AI模型部署在展場現場的硬體設備上。感測器捕捉到的資料直接在本地分析,運算結果立即驅動燈光、聲音或影像系統。這種架構將反應時間壓縮到10毫秒以內,達到人類無法察覺延遲的程度。

邊緣運算互動藝術的技術架構

完整的系統包含四個層次。

感測層負責捕捉觀眾的互動訊號。常用設備包括深度攝影機、麥克風陣列、壓力感測器、紅外線感應器等。選擇感測器時要考慮偵測範圍、精度需求和環境適應性。例如戶外裝置需要選擇防水防塵等級高的產品。

運算層是整個系統的核心。邊緣運算裝置需要具備AI推論能力,同時保持低功耗和穩定運作。市面上主流選擇包括:

| 裝置類型 | 適用場景 | 運算能力 | 功耗 |

|---|---|---|---|

| Jetson Nano | 小型裝置原型 | 472 GFLOPS | 5到10瓦 |

| Jetson Xavier NX | 中型互動裝置 | 21 TOPS | 10到15瓦 |

| Intel NCS2 | 輕量級應用 | 1 TOPS | 2.5瓦 |

| Coral Dev Board | 影像分類專用 | 4 TOPS | 2到3瓦 |

處理層運行AI模型進行即時推論。常見應用包括人體姿態估計、物件偵測、聲音事件分類、情感辨識等。模型需要經過量化和剪枝優化,在保持準確度的前提下降低運算需求。

執行層將運算結果轉換成藝術呈現。這可能是DMX燈光控制、OSC音訊協定、MIDI樂器觸發,或是投影機影像輸出。關鍵是建立穩定的通訊協定,確保指令準確傳遞。

從零開始建構邊緣運算互動裝置

實際創作需要按照系統化流程進行。

-

定義互動邏輯。先用紙筆或流程圖描繪觀眾的互動路徑。例如當觀眾舉起雙手時觸發音效A,靠近裝置時改變燈光顏色為藍色。清楚的互動設計是技術實作的基礎。

-

選擇AI模型。根據互動需求挑選預訓練模型或訓練自己的模型。姿態估計可以使用OpenPose或MoveNet,物件偵測可選擇YOLO或MobileNet SSD。優先考慮已經優化過的輕量級版本。

-

硬體整合測試。將模型部署到邊緣裝置上,連接感測器進行實際測試。記錄推論速度、準確率和資源使用情況。如果效能不足,需要調整模型複雜度或升級硬體規格。

-

建立通訊管線。撰寫程式將AI輸出轉換成控制訊號。例如使用Python的python-osc套件發送OSC訊息,或透過pyserial控制Arduino驅動的燈光系統。

-

現場調校優化。在實際展場環境中測試系統穩定性。調整感測器位置、光線補償參數、訊號觸發閾值等。準備備援方案應對突發狀況。

技術只是工具,創作意圖才是核心。不要讓技術限制想像力,而是用技術實現原本無法達成的藝術表達。先思考你想讓觀眾感受到什麼,再選擇適合的技術方案。

常見感測器與應用場景

不同類型的感測器適合不同的創作需求。

深度攝影機如Intel RealSense或Kinect能夠捕捉三維空間資訊。適合追蹤人體動作、計算距離、建立空間互動。缺點是對環境光線敏感,戶外使用效果較差。

熱感應器偵測紅外線輻射,可以在完全黑暗環境中工作。適合夜間裝置或需要隱蔽感測的作品。但解析度較低,無法辨識細節動作。

麥克風陣列捕捉聲音方向和內容。可以辨識說話者位置、分析聲音情緒、偵測特定音效。需要注意環境噪音干擾和回音問題。

壓力感測器埋設在地板或牆面,偵測觸碰和重量變化。適合創造觸覺互動體驗。安裝時要考慮承重能力和防護措施。

光學流量感測器追蹤畫面中的運動向量。比完整的影像辨識更省電,適合只需要偵測移動方向的簡單互動。

選擇感測器時要考慮三個因素:

- 偵測精度是否符合創作需求

- 環境適應能力能否應對展場條件

- 資料輸出格式是否容易整合到系統中

模型優化與效能調校

原始的AI模型通常太大太慢,無法在邊緣裝置上即時運行。

量化將模型權重從32位元浮點數轉換為8位元整數。這能減少75%的模型大小和運算量,準確度通常只下降1到3%。TensorFlow Lite和PyTorch Mobile都提供量化工具。

剪枝移除模型中貢獻度低的神經元連接。可以減少30到50%的參數量,同時保持主要功能。需要重新訓練模型以恢復精度。

知識蒸餾用小模型學習大模型的輸出行為。訓練過程較複雜,但能得到效能和準確度兼具的輕量級模型。

架構搜尋使用自動化工具尋找最適合邊緣裝置的模型結構。Google的EfficientNet和MobileNet系列就是這樣設計出來的。

實測時要關注三個指標:

- 推論時間:單次處理需要多少毫秒

- 記憶體使用:峰值佔用是否超過裝置限制

- 準確率:優化後的效能是否仍滿足創作需求

如果優化後仍無法達到即時處理,可以考慮降低輸入解析度、減少處理幀率,或簡化互動邏輯。

實際案例分析

動作驅動聲景裝置使用Jetson Nano搭配RealSense D435深度攝影機。觀眾的手部動作透過MoveNet模型即時辨識,不同姿勢觸發不同的環境音效層。系統在15毫秒內完成從動作捕捉到聲音輸出的完整流程。

技術細節包括將MoveNet模型量化到INT8格式,推論時間從45毫秒降到12毫秒。使用Pure Data接收OSC訊息控制音訊合成。展出期間連續運作72小時無故障。

情感回應光雕投影結合臉部辨識和情緒分析。觀眾站在裝置前方,系統辨識表情後投影對應的視覺圖像。使用Coral Dev Board執行MobileNet SSD進行臉部偵測,再用自訓練的情緒分類模型判斷七種基本情緒。

挑戰在於展場光線變化大,需要動態調整攝影機曝光參數。最終採用紅外線補光燈穩定影像品質,並在模型訓練時加入大量不同光線條件的樣本。

多人協作音樂裝置可同時追蹤五位參與者的位置和動作。使用YOLO v5進行多人偵測,每個人的移動速度和方向對應不同樂器的音高和節奏。系統部署在Jetson Xavier NX上,處理1080p影像的幀率達到30 FPS。

關鍵技術是實作追蹤演算法,為每個人分配唯一ID並持續追蹤。這避免了人物交錯時的身份混淆問題。音訊輸出使用MIDI協定控制Ableton Live軟體合成器。

常見問題與解決方案

延遲仍然過高。檢查是否有不必要的資料複製或格式轉換。使用GPU加速時確認CUDA版本正確安裝。考慮使用更快的模型架構或降低輸入解析度。

系統不穩定或當機。可能是記憶體洩漏或過熱問題。加入監控程式記錄資源使用情況,找出瓶頸環節。確保散熱系統正常運作,必要時加裝風扇。

偵測準確度不足。可能是訓練資料與實際場景差異太大。收集現場資料進行微調訓練。調整偵測閾值參數,在準確率和召回率之間取得平衡。

多個裝置同步困難。建立統一的時間基準,使用NTP協定同步系統時鐘。或採用主從架構,由一台裝置發送同步訊號給其他裝置。

電源供應問題。邊緣裝置通常需要穩定的5V或12V電源。使用工業級電源供應器,避免電壓波動造成系統重啟。規劃備用電池系統應對突然斷電。

軟體工具與開發環境

TensorFlow Lite是最成熟的邊緣AI框架。支援多種硬體平台,提供完整的模型轉換和優化工具。適合需要跨平台部署的專案。

PyTorch Mobile近年快速發展,語法更接近研究用的PyTorch。適合已經熟悉PyTorch的開發者。支援的硬體平台較TensorFlow Lite少。

OpenVINO由Intel開發,專門優化在Intel處理器和NCS加速器上的效能。如果使用Intel硬體,這是最佳選擇。

ONNX Runtime提供跨框架的模型部署方案。可以將不同框架訓練的模型轉換成統一格式,再部署到各種裝置上。

創作環境方面,Processing和TouchDesigner是視覺藝術家常用的工具。兩者都可以透過外掛或程式碼整合邊緣AI功能。Max/MSP和Pure Data適合聲音藝術創作,支援OSC和MIDI通訊協定。

從原型到展出的完整流程

原型階段重點是驗證互動概念。使用現成的開發板和感測器快速組裝系統,不需要考慮外觀和耐用性。測試核心功能是否如預期運作,記錄使用者的實際反應。

開發階段進行系統優化和整合。選擇適合長期運作的硬體元件,設計穩固的結構和防護外殼。撰寫錯誤處理和自動恢復機制,提高系統穩定性。

測試階段模擬實際展出環境。在不同光線、溫度、噪音條件下運行系統,找出潛在問題。邀請測試者體驗裝置,收集回饋意見並調整參數。

展出階段需要現場技術支援。準備備用硬體和快速替換方案。建立遠端監控系統,即時掌握裝置運作狀態。每天開展前進行系統檢查,確保所有功能正常。

未來發展趨勢

邊緣AI晶片效能持續提升。新一代處理器將提供更高的運算能力和更低的功耗,讓更複雜的模型能在小型裝置上運行。

多模態融合成為主流。結合視覺、聲音、觸覺等多種感測資料,創造更豐富的互動體驗。模型能夠理解跨模態的關聯性,做出更智慧的回應。

聯邦學習技術讓裝置能夠在保護隱私的前提下持續學習。多個裝置共同訓練模型,但原始資料不離開本地端。這為長期展出的互動藝術提供了自我進化的可能。

5G和邊緣運算的結合創造混合架構。簡單任務在本地處理保證即時性,複雜運算可以快速傳送到附近的邊緣伺服器。這平衡了效能和彈性需求。

技術與藝術的平衡點

邊緣運算互動藝術不是單純的技術展示。

最成功的作品往往技術隱藏在背後,觀眾只感受到流暢自然的互動體驗。過度強調技術會讓作品變成科技產品展示,失去藝術的本質。

創作時要問自己:這個技術是否真的服務於藝術表達?如果拿掉某個功能,作品的核心訊息是否仍然完整?技術應該是實現創意的手段,而不是創作的目的。

同時也要認識技術的限制。AI模型會有誤判,感測器會受環境干擾,硬體可能故障。將這些不確定性納入創作思考,甚至轉化為作品的一部分,能創造出更真實、更有機的互動體驗。

保持學習和實驗的心態。邊緣運算技術快速演進,新的工具和方法不斷出現。參與社群討論,分享創作經驗,與其他創作者交流,能夠持續拓展創作可能性。

開始你的第一個專案

從簡單的互動開始。選擇一個明確的互動目標,例如偵測揮手動作後改變燈光顏色。使用入門級硬體如Jetson Nano和網路攝影機,搭配預訓練的姿態估計模型。

設定實際的時間表。預留充足的測試和調校時間,技術整合通常比預期花費更多時間。建立檢查點,確保每個階段都達到預期目標再往下進行。

記錄整個過程。拍攝照片、撰寫筆記、保存程式碼版本。這些資料不只是作品文件,也是未來專案的寶貴參考。

尋找合作夥伴。如果你是藝術家但技術經驗有限,找一位工程師合作。如果你是技術人員想嘗試藝術創作,與藝術家交流能獲得新的視角。跨領域協作往往產生最有創意的作品。

邊緣運算互動藝術正在重新定義觀眾與作品的關係。每個人的動作、表情、聲音都成為創作的一部分,藝術不再是單向的觀看,而是雙向的對話。技術讓這種對話變得即時、流暢、充滿可能性。現在就開始動手,用邊緣運算實現你腦中的互動藝術想像。